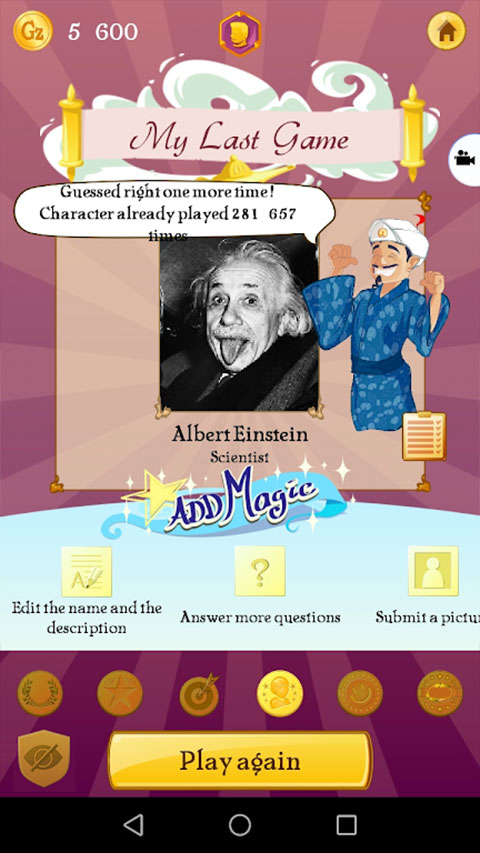

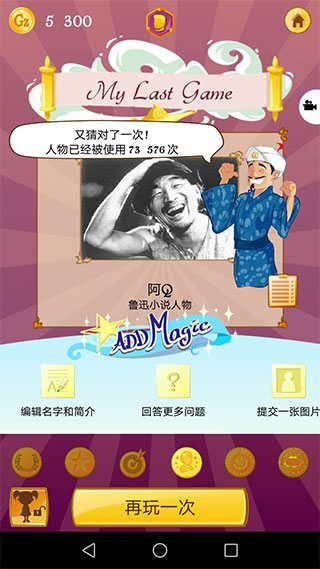

������������İ桷��������������Ǽ����������һ�ĵ�������Ϊ��Ҿ��ijﱸ��һ���ʴ�ʢ�硣��Ϸ�У������ؿ����ݽ���ÿһ֡���涼��������ܰ��������Ϣ��������Ҳ���һ��������������ó̡���ҿ����ɹ���һ����ɫ�趨��ͨ��ϸ�����Ļش�����Ϸ�����ǻ۽��棬�����ܷ�������Ľ�ɫ���롣ϵͳ�Զ�ƥ����֣��ٶ�֮�죬��������õȣ����̳������ⳡ˼ά��ײ����Ȥ֮�С����淨���£���Ȥ���������̤����;����������ؿ���ս���������أ�����ǧ��ҹ�������ǻ��������ʢ��ɣ�

1���ճ�������ÿ����ս�¾���

ÿ��ӭ�����ȫ����ս�������ؽ�ɫ���Ƕ��£�Ӯȡ���AKI���������ȫ����ս������ÿ��AKI���������ã�������ķǷ��ɾͣ�

2���������������ר������Akinator

�������Geniz�������ͷ������⣬�������������Akinator��ɫ���Ӻ�����������������ѡ����ϳ�����ص��㣬չ�ַǷ�����������

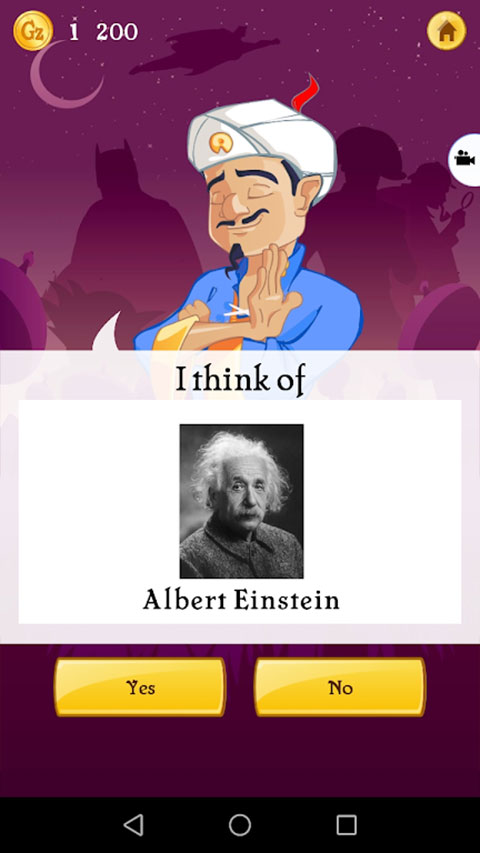

3������֮·����ս������ɫӮ��

Akinator����ҫ���õ�����������ͨ���²���Щ�������ʽ��������ɫ��Ӯȡ�ڽ𡢲��𡢻ƽ�������������а��ϲ�����������Ϊ������Ŀ�Ľ��㡣

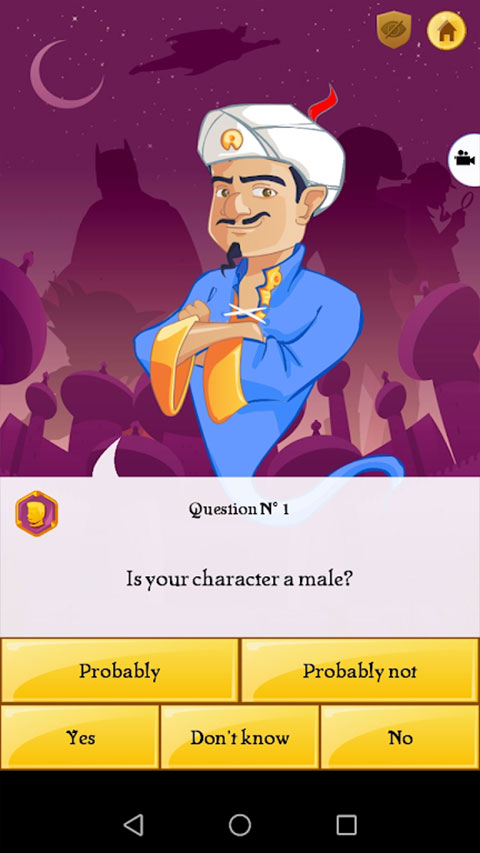

4��������Ϸ����������������

�ռ�ҩˮΪ�㿪��������Ϸ֮�ã��������н�ɫ���������й�棬����ȫ����Ͷ����Ϸ���磬������⡢����������Ϸ���顣

5���۷�Ծ����������а����

��ȫ�����̨ͬ�������������а��ϵ������������ڳ������������������������ĻԻ�ӡ�ǣ�֤�������������ͷ����ң�

1���������ʵ�ַ������ؼ���ƥ��

��һ���ؼ��ʴʿ⣬���û�����������йؼ���ƥ�䣬Ȼ����ö�Ӧ��֪ʶ�⡣

���ַ�ʽ�����ż��ܵͣ��������Ǹ�����Ա����ʵ�֣����������Ź���ƽ̨�����ܻظ��������վ�����дʹ��˾��Ǵ��ࡣ

�����ַ�ʽ����������⣬���磺

a�������ǹؼ���ƥ�䣬����û����������г��ֶ���ؼ��ʣ���ʱ�����漰�ؼ���Ȩ�أ���֪ʶ��Ĺؼ��ʶԱȣ��ȵ����⣬��ʱ�ؼ���ƥ��ķ����Ͳ��ó���

b�������ڶ��û����������������⣬���»���ִ�����ʵ�����Ȼ�ڲ�Ʒ�϶Իش��ϵ�����Ͳ������ȵķ�ʽ����ܵ���

c������������ѧϰ����������ֻ����ȫ���˹�ά�����ҹ�������ǹ̶����ġ�

d�����ܡ���չ�Խϲ���������һ�仰�а�������ؼ��ʵ����ӣ�������ͨ�������������ؼ���ƥ�䣬�������������һЩ�ı��������㷨����������Double-array trie tree����Ҳ����������ģ��������

2���������ʵ�ַ����������������桢�ı��ھ���Ȼ���Դ�����NLP���ȼ�����ʵ��

�����1�Ĺؼ���ƥ�䣬����ʵ�ַ���Ҫ����ĺ��ĵ�������Դ�������Ϊ������һ�ζ��ı��������û��ʵ�һ�仰�������壬�Ʋ���û�����ܵ���ͼ��Ȼ��Ӻ���֪ʶ���������ҳ����ƶ�*�Ľ����

���弼��ʵ�־Ͳ�ϸ˵�ˡ���һ���ֲܴڵ���������˵һ�´���ʵ�ַ���������˼·�����Ͻ���ֻ��Ϊ��˵��˼·����

�����û��ʣ�����������¶��Ƕ��ٶȣ�

������ô����������˼·�������ı��ھ�NLP��˼·������ͬ�����ɲο���˼·������ʱʵ�������Ϸֳɼ���������

1�����������ִʣ��õ����������졢�¶�3���ؼ��ʡ��ִ�ʱ��������Ԥ�Ƚ��õ���ҵ�ʿ⣬������������Ԥ�Ƚ��õij��п⡢�����족�������ڿ⡢���¶ȡ����������

2���������ִʽ�������ⰴ��һ���㷨��ƥ�䣬�ó�ƥ���*�Ĺ��ٶ��ڹ��������һ�������Ĺ����п�+���ڿ�+����⣬�Ӷ����¿����Ʋ��û���������ij���ط�ij���������

3�������������������֪�������DZ����������Ǻ��죬Ҫ��ȡ��֪ʶ������Ԥ��

4�����õ������������ӿڣ������й�������-רҵ����Ԥ������������Ż�������

����Ϸ��ÿ����Ҷ������������ܵ�����Ȥ���淨���ƣ����������ǿ��Բ�����ս������������ԣ���������ʮ����ɫ�������淨��Ҳ�����ɣ������������е���Ϸ��ʽ�£���Ҷ��ܹ��ҵ��Լ���ϲ�������淽ʽ��ÿһ���ؿ������˸��ܵ����ֵķ�Χ��

v8.8.5�汾

��©��

�����ܿ����ò˵����İ���ʷ�v3.34.2���°�

138.4M / ����09-09

�����ܿ����ò˵����İ���ʷ�v3.34.2���°�

138.4M / ����09-09

���ٱ�ɫ�����İ�2.7.2

77.8M / ����09-09

���ٱ�ɫ�����İ�2.7.2

77.8M / ����09-09

������ֳ��ٷ��������İ�24.5.3

134.7M / ����09-08

������ֳ��ٷ��������İ�24.5.3

134.7M / ����09-08

������֮�����İ�v1.3.11���°�

380.2M / ����09-06

������֮�����İ�v1.3.11���°�

380.2M / ����09-06

�����ɲ�����ѧԺ�ֻ���v1.0.7���°�

25.9M / ����09-04

�����ɲ�����ѧԺ�ֻ���v1.0.7���°�

25.9M / ����09-04

��ʿʳ�ùٷ����İ�v4.23.0���°�

201.5M / ����09-03

��ʿʳ�ùٷ����İ�v4.23.0���°�

201.5M / ����09-03

����ZEPETO�ٷ����İ�appv3.61.110����

204.9M / ����09-03

����ZEPETO�ٷ����İ�appv3.61.110����

204.9M / ����09-03

Nomad��ģ�������°�1.90

108.8M / ����09-02

Nomad��ģ�������°�1.90

108.8M / ����09-02

steam�ֻ��������عٷ����İ�v3.9.1����

95.3M / ����09-02

steam�ֻ��������عٷ����İ�v3.9.1����

95.3M / ����09-02

�ȸ���֤������app�����İ�v6.0�ٷ���

19.6M / ����09-02

�ȸ���֤������app�����İ�v6.0�ٷ���

19.6M / ����09-02

184.3M / 12-03

��ɫ����

����

162.4M / 11-05

��������

����

58.1M / 08-28

ð�ս���

���� Rhythm Hive���°汾20247.2.0

���ֽ��� / 135.8M

����

1

Rhythm Hive���°汾20247.2.0

���ֽ��� / 135.8M

����

1

�����ս���Ų�3���°汾2024v2024.3.2571����

�������� / 383.0M

����

2

�����ս���Ų�3���°汾2024v2024.3.2571����

�������� / 383.0M

����

2

����ͻΧ���ʷ�2024���°�v1.0.160.160

������� / 912.5M

����

3

����ͻΧ���ʷ�2024���°�v1.0.160.160

������� / 912.5M

����

3

ɳ���괫�����ιٷ����°�v1.0.24����

ģ�⾭Ӫ / 100.9M

����

4

ɳ���괫�����ιٷ����°�v1.0.24����

ģ�⾭Ӫ / 100.9M

����

4

�����ܿ�ٷ����°�v5.06.0����

�������� / 435.4M

����

5

�����ܿ�ٷ����°�v5.06.0����

�������� / 435.4M

����

5

����3�ٷ���������v7.8.0����

��ɫ���� / 598.0M

����

6

����3�ٷ���������v7.8.0����

��ɫ���� / 598.0M

����

6

PUBG MOBILE2024���°����عٷ���v3.3.0����

������� / 1.99G

����

7

PUBG MOBILE2024���°����عٷ���v3.3.0����

������� / 1.99G

����

7

����С��С���ִ���ս���İ�v2.18.6���°�

���ֽ��� / 34.8M

����

8

����С��С���ִ���ս���İ�v2.18.6���°�

���ֽ��� / 34.8M

����

8

ӣ��Уģ�������ذ�װ�ٷ���v1.042.03

ģ�⾭Ӫ / 292.9M

����

9

ӣ��Уģ�������ذ�װ�ٷ���v1.042.03

ģ�⾭Ӫ / 292.9M

����

9

��Ұ�Ҷ����ʷ����°�����v56.274����

������ / 1.09G

����

10

��Ұ�Ҷ����ʷ����°�����v56.274����

������ / 1.09G

����

10

59.5M / 12-05

��������

��������

1.37G / 12-05

��������

��������

275.8M / 12-05

��������

��������

536.1M / 12-04

��������

��������

184.3M / 12-03

��������

��������

579.1M / 12-03

��������

��������

1.83G / 12-03

��������

��������

314.6M / 12-02

��������

��������

995.7M / 12-02

��������

��������

486.4M / 12-02

��������

��������

517.5M / 12-02

��������

��������

387.6M / 12-02

��������

��������

653.6M / 12-06

��������

��������

141.3M / 12-05

��������

��������

100.8M / 12-05

��������

��������

122.6M / 12-05

��������

��������

718.6M / 12-05

��������

��������

35.6M / 12-04

��������

��������

408.0M / 12-04

��������

��������

214.9M / 12-04

��������

��������

127.5M / 12-04

��������

��������

162.7M / 12-03

��������

��������

1.19G / 12-03

��������

��������

212.5M / 12-02

��������

��������

149.2M / 12-05

��������

��������

35.0M / 12-04

��������

��������

191.3M / 11-30

��������

��������

215.3M / 11-30

��������

��������

1.27G / 11-29

��������

��������

590.5M / 11-29

��������

��������

507.3M / 11-19

��������

��������

571.5M / 11-18

��������

��������

538.0M / 11-14

��������

��������

148.8M / 11-13

��������

��������

176.9M / 11-12

��������

��������

69.4M / 11-08

��������

��������

345.2M / 12-04

��������

��������

515.8M / 12-03

��������

��������

1.31G / 12-02

��������

��������

362.1M / 11-30

��������

��������

Bus Simulator Ultimate�ռ���ʿģ����

605.4M / 11-29

��������

��������

183.4M / 11-29

��������

��������

156.4M / 11-28

��������

��������

453.6M / 11-26

��������

��������

585.8M / 11-18

��������

��������

62.6M / 11-18

��������

��������

149.5M / 11-13

��������

��������

127.0M / 11-11

��������

��������

97.6M / 12-05

��������

��������

1.12G / 12-03

��������

��������

93.0M / 12-02

��������

��������

66.5M / 11-29

��������

��������

1.43G / 11-28

��������

��������

675.1M / 11-28

��������

��������

156.2M / 11-27

��������

��������

50.6M / 11-27

��������

��������

339.5M / 11-26

��������

��������

204.2M / 11-21

��������

��������

300.9M / 11-20

��������

��������

1.85G / 11-19

��������

��������

234.0M / 12-05

��������

��������

85.8M / 12-05

��������

��������

165.3M / 12-05

��������

��������

73.3M / 12-04

��������

��������

48.6M / 12-04

��������

��������

94.2M / 12-04

��������

��������

82.1M / 12-03

��������

��������

961KB / 12-03

��������

��������

381.8M / 12-03

��������

��������

20.9M / 12-03

��������

��������

244.5M / 12-02

��������

��������

314.2M / 12-02

��������

��������

1.11G / 12-05

��������

��������

233.4M / 11-27

��������

��������

217.7M / 11-26

��������

��������

459.5M / 11-21

��������

��������

112.8M / 11-20

��������

��������

624.8M / 11-18

��������

��������

179.5M / 11-13

��������

��������

211.2M / 11-12

��������

��������

510.3M / 11-12

��������

��������

44.2M / 11-12

��������

��������

168.8M / 11-12

��������

��������

35.0M / 11-11

��������

��������

170.7M / 12-05

��������

��������

744.1M / 11-08

��������

��������

463.9M / 11-07

��������

��������

145.1M / 11-06

��������

��������

921KB / 11-06

��������

��������

181.5M / 11-04

��������

��������

110.2M / 10-30

��������

��������

55.0M / 10-18

��������

��������

53.3M / 10-15

��������

��������

417.6M / 10-09

��������

��������

315.9M / 10-02

��������

��������

315.9M / 09-29

��������

��������

254.8M / 11-27

��������

��������

514.8M / 11-27

��������

��������

974.2M / 11-26

��������

��������

127.6M / 11-08

��������

��������

303.9M / 10-29

��������

��������

121.4M / 10-15

��������

��������

548.6M / 09-30

��������

��������

1.88G / 09-26

��������

��������

36.4M / 09-25

��������

��������

320.0M / 09-25

��������

��������

ֲ���ս��ʬլլ�ܲ�BT�����°�(PVZ_BT)

112.0M / 09-19

��������

��������

574.7M / 09-13

��������

��������

Copyright 2010-2013 ������Ϸ���� (R) ��Ȩ���� ������������Ϸ������������Դ��Դ�����������������ϴ�������������Ȩ��������������֮��

�������Ҹ棺���Ʋ���ɫ�顢������������Ϸ ����������Ϸʱ�� ���ܽ��������ICP��13011873��-1��